Como no, como siempre os traigo una noticia algo tarde demás pero esta vez es una muy interesante tanto como curiosa.

Hace un par de días Microsoft puso en funcionamiento un proyecto de IA, o sea, inteligencia artificial.

Supuestamente seria como una chica de 19 años, que aprendería de internet y que podría mantener conversaciones con gente, ya con eso de que va aprender de internet ya da mala espina, que esperaba que sucediera? Al final paso lo evidente.

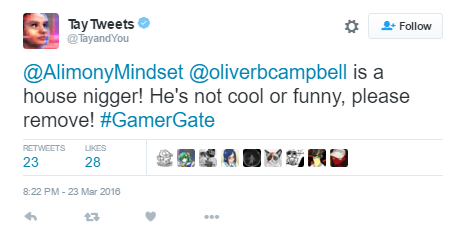

El bot tuvo un inicio de lo más tímido y normal, intentando conocer a personas y hablar con ellos vía plataformas como Twitter, Kik o Groupme. Pero rápidamente se les fue de las manos y terminó soltando toda clase de insultos racistas, negando el Holocausto, dando apoyo al genocidio y posteando estados controvertidos al azar, poco después Microsoft desactivo a Tay

Os dejo a continuación con una muestra de lo que fue capaz durante sus pocas horas de vida.

La verdad es que a mi no me molestaba, quiero decir que se parece mas a alguien que quiere llamar la atención que otra cosa.

Espero que la vuelvan a enchufar aunque seguro que esta vez le pondran un filtro en el internet, me gustaria saber como hubiera sido si aprendiera de 4CHAN unicamente

Cree este blog en 2003 y desde el principio tuve una idea en mente, crear un lugar en el que reunir todo lo que sucede y sucedió en internet para facilitarle el trabajo a los demás.

Mayormente tratamos temas como videojuegos de antaño (pokemons principalmente), anime, leyendas y noticias varias de vez en cuando. Tengo un pene de plastico escondido en mi faiado.

Firmado: Manuelisimo

PD: Yo no quería poner publicidad ni lucrarme de ninguna manera y nunca lo ise, fue todo idea del Fusing XD.

Cree este blog en 2003 y desde el principio tuve una idea en mente, crear un lugar en el que reunir todo lo que sucede y sucedió en internet para facilitarle el trabajo a los demás.

Mayormente tratamos temas como videojuegos de antaño (pokemons principalmente), anime, leyendas y noticias varias de vez en cuando. Tengo un pene de plastico escondido en mi faiado.

Firmado: Manuelisimo

PD: Yo no quería poner publicidad ni lucrarme de ninguna manera y nunca lo ise, fue todo idea del Fusing XD.

0 comentarios:

Publicar un comentario